Le gouvernement français prévoit d’introduire un système de vidéosurveillance muni d’intelligence artificielle lors des Jeux olympiques et paralympiques qui se tiendront à Paris en 2024. Adopté par le Sénat avec une très large majorité, 245 voix pour et 28 voix contre, le projet de loi vient d’être confirmé le jeudi 23 mars par l’Assemblée nationale dans le cadre d’une procédure législative accélérée. La France deviendra donc très prochainement le premier État de l’Union européenne à légaliser de manière explicite l’usage de l’intelligence artificielle à des fins sécuritaires.

Malgré l’opposition de nombreuses organisations de la société civile, le projet de loi relatif aux Jeux olympiques et paralympiques entrera très prochainement en vigueur. Sous prétexte d’assurer la sécurité de ces deux évènements en cas de manque d’effectifs physiques où 20 000 agents de sécurité seraient nécessaires, et pour ne pas répéter le scénario chaotique de la finale de la Ligue des champions au Stade de France en mai dernier, cette nouvelle loi ouvre la voie à la banalisation de l’utilisation de l’intelligence artificielle dans nos systèmes de sécurité, et crée une dangereuse base juridique pour son futur développement dans l’espace public.

Selon ses opposants, cette loi manque aux principes de nécessité et de proportionnalité, et implique des risques de violation de nombreuses libertés fondamentales. Il est également reproché au gouvernement de n’avoir engagé aucun dialogue avec la société civile au sujet du déploiement de ce type de technologie.

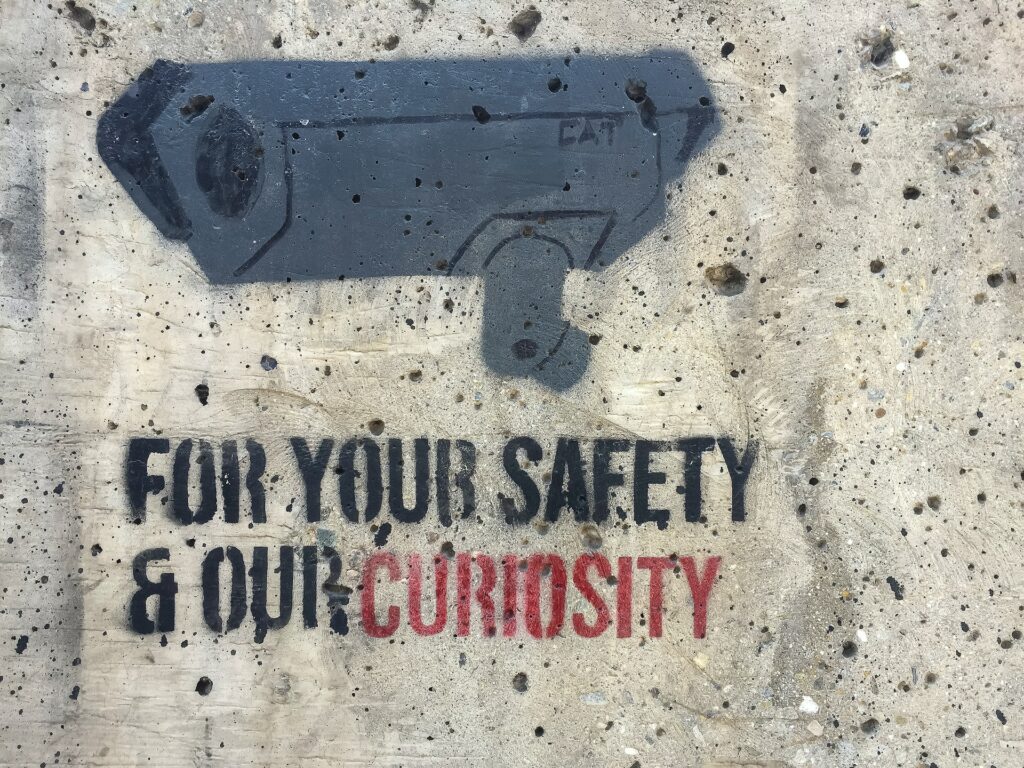

Big Brother is watching you

À travers son article 7, cette loi organise un cadre expérimental autorisant le recours à des traitements algorithmiques sur les images captées par des dispositifs de vidéosurveillance afin de prévenir des « situations dangereuses » pour la sécurités des personnes lors d’évènements sportifs, festifs ou culturels, dont notamment de nature terroriste. En effet, à l’aide d’un système d’intelligence artificielle, ces caméras dites « augmentées » auront pour objet l’analyse automatique d’images en temps réel, par des algorithmes, leur permettant de détecter des évènements ou comportements prédéterminés, tels que des mouvements de foules, des bagarres, des gestes ou comportements considérés comme étant suspects, etc.

Extrait de la BD de Grisebouille contre la surveillance biométrique (dont on peut retrouver le site internet ici)

Extrait de la BD de Grisebouille contre la surveillance biométrique (dont on peut retrouver le site internet ici)Pour la commission nationale de l’informatique et des libertés (CNIL), « le déploiement, même expérimental, de ces dispositifs constitue un tournant qui va contribuer à définir le rôle général qui sera attribué à ces technologies, et plus généralement à l’intelligence artificielle ». Face aux nombreuses craintes du développement d’une telle technologie dans l’espace public, le gouvernement a assuré que ces caméras étaient assorties de nombreuses garanties, dont l’exclusion de la reconnaissance faciale. En effet, la disposition prévoit notamment que « ces traitements n’utilisent aucun système d’identification biométrique, ne traitent aucune donnée biométrique et ne mettent en œuvre aucune technique de reconnaissance faciale. Ils procèdent exclusivement à un signalement d’attention, strictement limité à l’indication du ou des évènements prédéterminés qu’ils ont été programmés pour détecter. Ils ne produisent aucun autre résultat et ne peuvent fonder, par eux-mêmes, aucune décision individuelle ou acte de poursuite ».

Les députés de l’Assemblée nationale ont également précisé, à l’occasion de l’adoption de plusieurs amendements, que le public devra être informé préalablement à son entrée dans un périmètre où des caméras intelligentes seront effectives. Ces caméras pourront être déployées dès l’entrée en vigueur du texte de loi jusqu’au 31 décembre 2024. Elles pourront donc potentiellement être testées lors de la Coupe du monde de rugby qui se tiendra en septembre 2023, et jusqu’après l’échéance des JO de 2024, sortant ainsi pleinement du cadre qui « justifiait » leur déploiement.

JO 2024 – Flickr

JO 2024 – FlickrRisque d’atteinte aux libertés fondamentales

38 organisations civiles, dont Human Rights Watch, ont dénoncé l’utilisation de cette nouvelle technologie dans l’espace public, et demandé le retrait de l’article 7 du texte de loi à l’occasion de la publication d’une lettre publique. Selon elles, les mesures de surveillance intelligente introduites sont contraires aux droits humains, dans la mesure où elles ne satisfont pas aux principes de nécessité et de proportionnalité, et impliquent des risques inacceptables de violation de plusieurs libertés fondamentales telles que le droit à la vie privée, le droit à la liberté de réunion et d’association et le droit à la non-discrimination.

Frederike Kaltheuner, directrice de la division Technologie et Droits humains à Human Rights Watch a notamment déclaré :

« Selon nos organisation, la disposition relative à la surveillance contenue dans le projet de loi constituerait une grave menace pour les libertés civiques et les principes démocratiques. Elle augmenterait le risque de discrimination raciale dans l’application de la loi et constituerait un pas de plus vers la normalisation de mesures de surveillance exceptionnelle sous prétexte d’assurer la sécurité de grands évènements »

Cette mesure pourrait également avoir un effet dissuasif concernant l’exercice de ces droits fondamentaux, et risque d’exacerber la stigmatisation de certaines minorités raciales, ethniques et religieuses, ainsi que la discrimination des personnes qui passent beaucoup de temps dans l’espace public, dont notamment les sans-abris et les personnes en situation de vulnérabilité économique ou de handicap. Selon l’ONG, il est prouvé que l’utilisation des technologies de surveillance crée un état de contrôle, de profilage et de suivi permanent qui nuit de manière disproportionnée aux personnes marginalisées.

Tbilisi, Georgien. Mars 2020. Photo de Etienne Girardet sur Unsplash

Tbilisi, Georgien. Mars 2020. Photo de Etienne Girardet sur UnsplashEnfin, elle considère que ce système de surveillance impliquera automatiquement la reconnaissance faciale, malgré les promesses contraires du gouvernement. « Si l’usage de caméras dotées d’algorithmes est destiné à détecter des événements suspects spécifiques dans l’espace public, ces caméras capteront et analyseront forcément des traits physiologiques et des comportements de personnes présentes dans ces espaces. Il pourra s’agir de la posture de leurs corps, de leur démarche, de leurs mouvements, de leurs gestes ou de leur apparence. Le fait d’isoler des personnes par rapport à leur environnement, qui s’avère indispensable en vue de remplir l’objectif du système, constitue une identification unique », ont dénoncé les organisations signataires de la lettre.

Violation de la future loi européenne sur l’IA

Le 17 mars dernier, une quarantaine de députés européens ont également appelé leurs homologues français à s’opposer au vote de l’article 7 du texte de loi. En effet, en adoptant cette disposition, la France risque d’entrer en conflit avec la loi européenne sur l’intelligence artificielle qui devrait être prochainement adoptée par le Parlement européen. En effet, en 2021, l’institution européenne avait déjà appelé à « l’interdiction permanente de l’utilisation de l’analyse automatisée, des caractéristiques humaines et d’autres signaux biométriques et comportementaux ». Le règlement est en cours de négociation, et il existe déjà une majorité favorable à une interdiction stricte de la surveillance biométrique de masse.

Il est regrettable que le gouvernement et les députés français aient préféré ignorer l’appel de la société civile. Bien qu’il s’agisse à ce jour d’un déploiement expérimental qui s’inscrit dans le cadre des Jeux olympiques de 2024, nous craignons qu’elle soit au contraire la première étape vers une pérennisation de ce système de surveillance dans l’espace public …

– W.D.

Photo de couverture de Matthew Henry sur Unsplash

The post La vidéosurveillance par IA débarque en France first appeared on Mr Mondialisation.

1 year ago

48

1 year ago

48